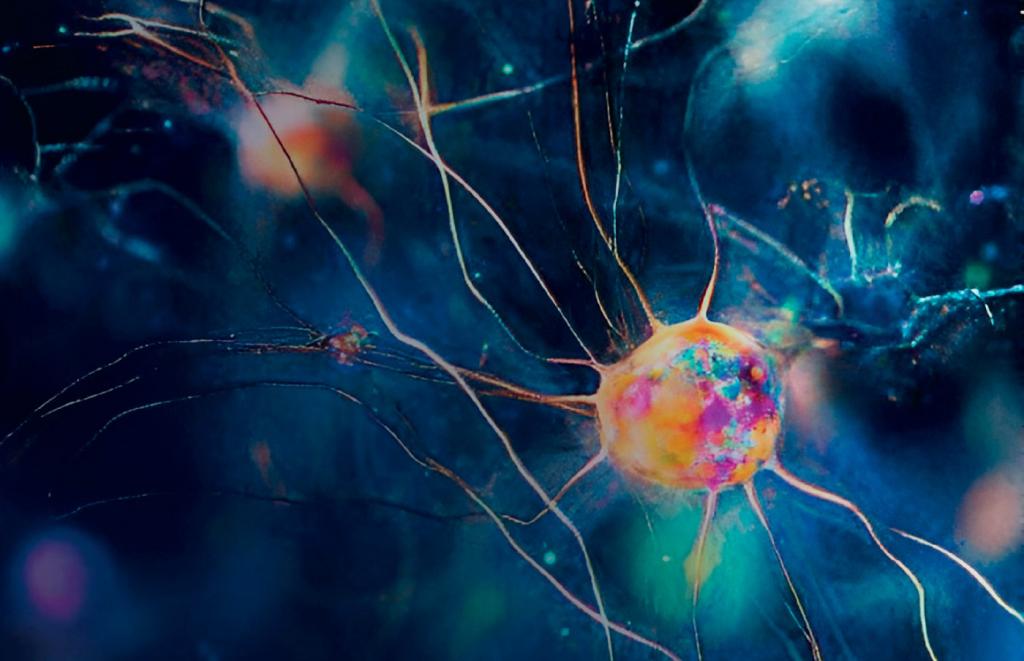

Новое исследование ученых Стэнфордского университета, показало, что современные языковые модели демонстрируют признаки человеческого мышления в большей степени, чем считалось ранее. Анализ ответов, сгенерированных ИИ, выявил поведение, характерное для человеческого интеллекта.

Исследователи использовали серию тестов, разработанных для оценки когнитивных искажений у людей, и применили их к различным языковым моделям. Результаты показали, что ChatGPT подвержен тем же типам логических ошибок, что и люди, включая эффект якоря, предвзятость подтверждения и склонность к стереотипам.

Ученые подчеркивают, что эти результаты не означают, что ИИ обладает сознанием или чувствами. Однако они свидетельствуют о том, что сложные алгоритмы машинного обучения могут воспроизводить определенные аспекты человеческого мышления, даже с его недостатками.

Эти открытия позволяют разрабатывать методы для более справедливых и надежных результатов, сообщает The SciTechDaily.